hoặc

Vui lòng nhập thông tin cá nhân

hoặc

Vui lòng nhập thông tin cá nhân

Nhập email của bạn để lấy lại mật khẩu

hoặc

Vui lòng nhập thông tin cá nhân

hoặc

Vui lòng nhập thông tin cá nhân

Nhập email của bạn để lấy lại mật khẩu

Từ những bức ảnh "Tổng tài bị lập biên bản giao thông" đến việc tự nhận mình là nhân vật trong vụ "Chị Hồng Nam Kinh", trào lưu dùng AI để tạo ra hình ảnh giả đang lan rộng trên mạng xã hội. Dù xuất phát từ ý tưởng “vui vẻ”, hệ quả của chúng đang ngày càng vượt ngoài giới hạn đạo đức và pháp luật.

Từ đầu tháng 7, mạng xã hội Việt Nam xuất hiện hàng loạt hình ảnh người dùng bị cảnh sát giao thông lập biên bản. Trong ảnh, nhân vật thường mặc đồ hiệu, tạo dáng bên xe sang, đi kèm những chú thích mang tính giễu cợt: “Mời chị ký vào đây”, “OK, ký thì ký”, “Đưa biên bản đây chị ký”…

Thoạt nhìn, không ít người tưởng đây là ảnh thật. Tuy nhiên, những bức ảnh này đều là sản phẩm của công nghệ AI, được tạo ra bằng các công cụ ghép ảnh tự động, với chi tiết và bố cục tinh vi tới mức đánh lừa cả người dùng mạng xã hội lâu năm.

Chỉ trong vòng một tuần, loạt ảnh “tạo dáng thần thái bên xe dù đang bị phạt” phủ sóng các fanpage và hội nhóm lớn, thu hút hàng triệu lượt tương tác. Đáng chú ý, không ít bình luận đi kèm thể hiện thái độ xem nhẹ pháp luật, thậm chí xúc phạm lực lượng chức năng. Một số người dùng còn tỏ ra hả hê vì “ảnh ghép mà cũng giống thật đến thế”.

Mức độ nghiêm trọng tăng cao khi Á hậu 1 Miss Fitness Vietnam 2022 – Phương Thảo – đăng tải bức ảnh ghép bằng AI với nội dung tương tự. Trong ảnh, cô diện nguyên cây đồ hiệu, đứng bên siêu xe hơn 10 tỷ đồng, phía sau là hai cảnh sát giao thông đang làm nhiệm vụ. Dòng mô tả “Mời chị ký vào đây” kèm biểu tượng mặt cười khiến nhiều người phản ứng dữ dội. Bài đăng (sau đó đã bị ẩn hoặc xóa) nhận về hàng loạt chỉ trích vì “đùa quá trớn”, “bôi nhọ lực lượng chức năng”.

Nhiều người cho rằng, khác với các trường hợp ghép ảnh vô danh, việc một người nổi tiếng công khai đăng tải ảnh chế gắn với hình ảnh công an là hành vi nghiêm trọng hơn, có dấu hiệu lan truyền thông tin sai sự thật, gây ảnh hưởng tiêu cực đến hình ảnh người thi hành công vụ. Một số tài khoản thậm chí đã gắn thẻ trang chính thức của lực lượng chức năng để yêu cầu xử lý vụ việc.

Phương Thảo không đưa ra bất kỳ lời giải thích hay xin lỗi nào, ngay cả khi liên tục bị gọi tên trên mạng xã hội.

Khi tranh cãi về ảnh vi phạm giao thông còn chưa lắng xuống, mạng xã hội Việt Nam lại tiếp tục xuất hiện một trào lưu khác, được đánh giá là nguy hiểm hơn nhiều lần. Đó là trào lưu “tự nhận là nạn nhân” trong vụ án tình dục gây chấn động đang được điều tra ở Trung Quốc – vụ việc liên quan đến nhân vật được dân mạng gọi là “Hồng tỷ”.

Theo thông tin từ báo chí Trung Quốc, nghi phạm trong vụ án là một người đàn ông 38 tuổi, thường xuyên cải trang phụ nữ, bí mật ghi lại hơn 1.600 video có nội dung nhạy cảm với các nạn nhân nam giới, sau đó phát tán lên Internet. Vụ việc nhanh chóng gây chấn động dư luận Trung Quốc, rồi lan sang Việt Nam qua các nền tảng mạng xã hội.

Thay vì lên án, nhiều người dùng mạng lại chế ảnh ghép khuôn mặt mình hoặc nhân vật khác thành nạn nhân trong vụ việc. Trào lưu “mang quà sang gặp Hồng tỷ” lan nhanh, đặc biệt trên TikTok, với các video hóa trang, lồng tiếng và tạo dựng bối cảnh “đến gặp chị Hồng”. Không ít TikToker và diễn viên trẻ tham gia, với mục đích “bắt trend”, dù nội dung hoàn toàn liên quan đến một vụ án có yếu tố hình sự nghiêm trọng.

Dù khác bối cảnh, cả hai trào lưu – từ việc ghép ảnh bị cảnh sát lập biên bản đến việc tự nhận là nạn nhân vụ Hồng tỷ – đều chung một bản chất: lợi dụng công nghệ AI để lan truyền thông tin giả mạo, giễu cợt nạn nhân, coi thường lực lượng chức năng và làm sai lệch nhận thức cộng đồng.

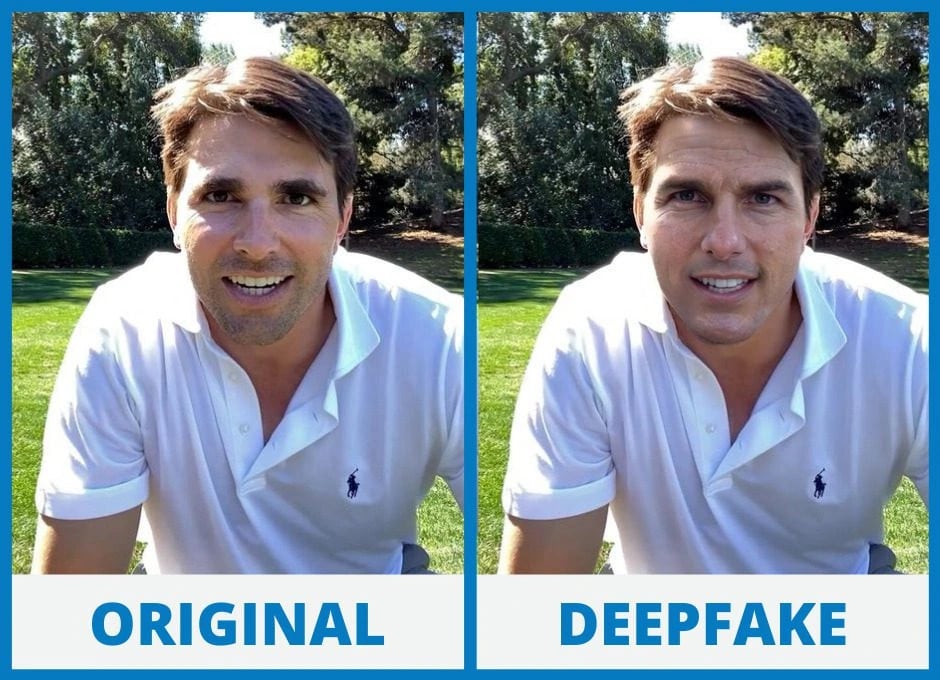

Công nghệ trí tuệ nhân tạo (AI), đặc biệt là các công cụ tạo ảnh và video như deepfake, đang đặt ra những thách thức nghiêm trọng đối với xã hội hiện đại.

Renée DiResta, Giám đốc nghiên cứu tại Viện Quan sát Internet thuộc Đại học Stanford (Mỹ), cho rằng deepfake là một trong những công nghệ nguy hiểm nhất hiện nay bởi khả năng phá vỡ ranh giới giữa thật và giả. Bà cảnh báo: “Người dùng thường không nhận ra rằng, hành vi chia sẻ những hình ảnh tưởng như chỉ để đùa vui cũng góp phần lan truyền thông tin sai lệch. Một khi công chúng không còn khả năng phân biệt thật – giả, lòng tin với báo chí, pháp luật và cả những giá trị nền tảng của xã hội sẽ sụp đổ”.

Trong khi đó, Yann LeCun – Giám đốc AI tại Meta, người từng được xem là “cha đẻ của deep learning” – khẳng định công nghệ không có đạo đức, chỉ con người sử dụng nó mới có. “Deepfake hay bất kỳ công nghệ AI nào cũng không tốt, không xấu. Vấn đề là người ta dùng nó để làm gì. Nếu không có rào chắn kỹ thuật, pháp lý và đạo đức, nó sẽ trở thành vũ khí phá hoại danh dự, gây rối loạn thông tin và đe dọa an ninh cá nhân”.

Nhiều chuyên gia khác như Sam Altman – CEO của OpenAI, James Manyika – Phó Chủ tịch phụ trách chính sách toàn cầu của Google, hay Nick Clegg – Chủ tịch phụ trách đối ngoại của Meta – đều đồng thuận rằng các nền tảng công nghệ cần chủ động kiểm soát nội dung AI, thông qua việc gắn nhãn ảnh do máy tạo, truy dấu nguồn gốc kỹ thuật số, cảnh báo người dùng và hợp tác với chính phủ để xây dựng luật chơi rõ ràng.

Trước làn sóng lạm dụng AI, nhiều quốc gia đã ban hành luật nhằm kiểm soát nội dung giả mạo và bảo vệ danh dự cá nhân.

Trước tốc độ phát triển quá nhanh của công nghệ trí tuệ nhân tạo, đặc biệt là AI tạo sinh (generative AI) và deepfake, nhiều quốc gia đã sớm ban hành hoặc bổ sung khung pháp lý nhằm ngăn chặn việc công nghệ bị lợi dụng để phát tán thông tin giả, bôi nhọ nhân phẩm hoặc gây ảnh hưởng đến an ninh xã hội.

Tại Mỹ, nhiều bang như California, Texas và Virginia đã thông qua các đạo luật chống deepfake, tập trung vào ba nhóm hành vi chính: sử dụng deepfake để can thiệp bầu cử, tạo nội dung khiêu dâm giả không có sự đồng thuận và giả mạo danh tính để lừa đảo. Đạo luật tại bang California cấm phát tán deepfake có mục đích gây tổn hại danh tiếng người khác trong vòng 60 ngày trước cuộc bầu cử, đồng thời cho phép nạn nhân khởi kiện dân sự. Ngoài ra, các trường hợp tạo nội dung deepfake có yếu tố quấy rối, khiêu dâm cũng có thể bị truy tố hình sự, với mức án tù từ một đến ba năm tù giam tùy mức độ nghiêm trọng.

Tại Trung Quốc, từ tháng 1/2023, nước này chính thức áp dụng “Quy định về quản lý dịch vụ tổng hợp hình ảnh và âm thanh do AI tạo ra” (Deep Synthesis Regulation). Quy định yêu cầu tất cả sản phẩm do AI tạo ra phải được dán nhãn rõ ràng, đồng thời yêu cầu các nhà cung cấp công cụ AI và nền tảng đăng tải nội dung phải xác minh danh tính người dùng. Các nội dung không xác minh nguồn gốc hoặc có dấu hiệu thao túng dư luận đều có thể bị gỡ bỏ ngay lập tức. Việc phát tán ảnh hoặc video deepfake có yếu tố chính trị, nhạy cảm hoặc xúc phạm tổ chức, cá nhân có thể bị xử lý hành chính hoặc hình sự.

Cùng lúc, các công ty công nghệ lớn như Meta, Google, Microsoft đang phát triển hệ thống phát hiện deepfake bằng cách phân tích dấu hiệu như nhấp nháy mắt bất thường, lỗi đồng bộ khẩu hình và âm thanh, chi tiết sai lệch trên khuôn mặt... Ngoài ra, công nghệ nhận dạng số (digital watermarking) cũng đang được nghiên cứu để xác định nguồn gốc ảnh AI, phục vụ việc truy vết và xử lý vi phạm.

© vietpress.vn